随着iOS 18.1 Beta的推出,注册开发者从现在开始就可以体验苹果AI的一些功能。

最明显的变化是Siri的彻底改版,变成了Apple&Siri。

另一个重大更新是写作功能,它可以在几秒钟内帮助润色 评论并安排高级表达方式。

就连脏话,也能在一瞬间变得优雅随和:

打开苹果之后,苹果自主研发的大端模型就会下载到设备上。

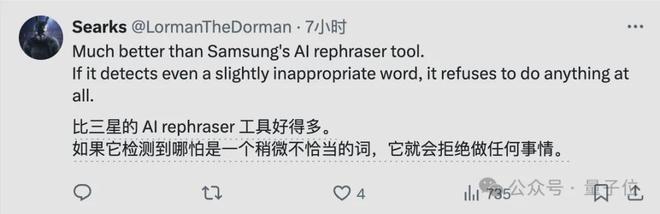

根据网友们手脚麻利的反馈,它并不像其他公司的AI那样经常拒绝服务。

与此同时,苹果自己的大型模型的报告也已发布,透露了大量技术细节。

报告显示,苹果基于云端的大型模型在遵循指令、总结文本等任务上取得了比 GPT-4 更好的效果。

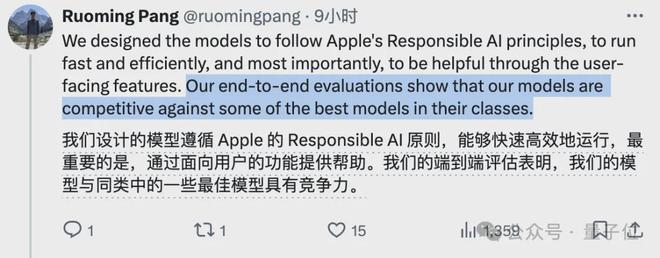

苹果基础大机型团队负责人庞若明也表示,其机型与同类产品中的一些最佳机型具有竞争力。

庞若明是普林斯顿大学计算机科学博士,曾分别在上海交通大学和南加州大学获得学士和硕士学位。在谷歌担任工程师 15 年后,他于 2021 年加入苹果。

苹果的主要对话功能是由他的团队开发的模型提供支持的。

这次他还强调,这些基础模型“不是聊天机器人”,而是支持包括摘要、写作辅助、工具使用和代码在内的广泛功能。

此外,苹果还研发了不少自研算法来帮助提升模型性能,具体信息也在报告中披露。

一些细心的网友还从中发现了一些亮点——

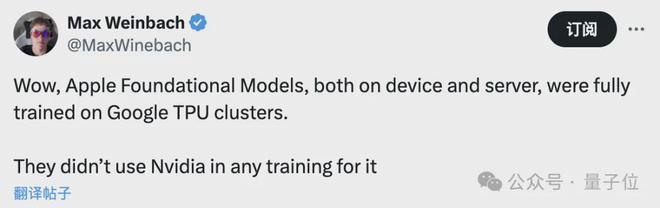

苹果的大型模型采用谷歌的TPU集群进行训练,含量为零。

Siri 已升级,但尚未连接

想要体验苹果的Apple,需要满足很多条件。

首先品鉴2023澳门全年资料大全免费,苹果 AI 来袭!iOS 18.1 Beta 版上线,Siri 换新,写作功能强大,体验反馈佳,搭载的iOS 18.1 Beta版本目前仅面向注册开发者开放,费用为每年99美元,普通用户还需要等待。

而且之前也提到过,它仅支持 M 系列和 A17 Pro 芯片,也就是说只有部分地区的 15 Pro 和 15 Pro Max 可以使用它。

除了硬件和身份要求外,系统设置也需要修改,地区要设置为美国,设备和Siri的语言也要改为英语。

一旦您满足了所有这些要求,就可以......加入等候队列了。

此次推出的苹果功能比较局部,主要集中在文本生成、Siri、相册等模块上。

先说文本生成,作为苹果AI的重要组成部分,该功能的应用范围并不局限于苹果官方的应用。

只要使用标准文本输入系统,此功能还可以用于第三方应用程序进行文本摘要、校对和重写。

此外,结合iOS 18 Beta语音备忘录中已经上线的音频转录功能,文本生成系统还能为录音生成摘要。

第二个更重要的更新是 Siri。

界面方面,新版Siri不再是圆形的图标,运行时,屏幕周围会有闪烁的彩色灯光。

对于不想语音对话的用户,它还提供了文字对话方式,双击屏幕下方即可调出键盘,通过打字的方式与 Siri 交流。

内容方面,新版Siri将能够回答与苹果产品相关的问题,并帮助用户排除故障。

此外,新版 Siri 将能够理解从一个查询到下一个查询的上下文,例如要求 Siri 创建日历事件一篇读懂2023年澳门正版资料大全,然后要求创建提醒,而无需重述正在谈论的内容。

不过,此前推出的屏幕感知功能并未包含在本次 Siri 更新中。

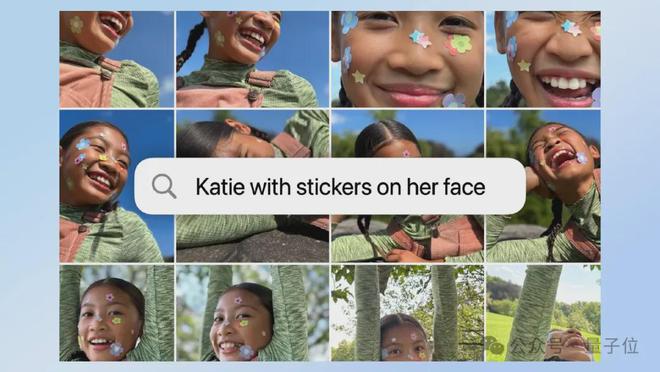

照片应用程序的更新允许用户使用自然语言搜索特定的照片甚至视频中的特定时刻。

以上就是本次开发者测试版关于AI的大致内容,需要指出的是,这只是之前发布会上演示的部分功能,还有很多功能还未上线。

特别是,前面提到的集成尚未包含在此更新中。

解读苹果模式

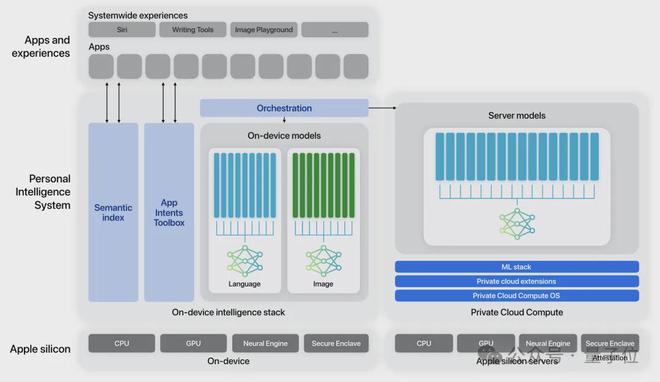

苹果曾表示,这并不是Apple AI中的必选选项,主要功能由自己的大型模型驱动。

关于这款机型,苹果在上线的同时还发布了一份全面的技术报告。

该模型的名字简单粗暴,被称为苹果基本模型(Apple Model,缩写为AFM),它有端侧(on-side)和云端(cloud-side)两个版本。

端侧模型的参数数量在3B左右,云端模型的参数数量未透露,只是比端侧模型要大一些,两者都有32k的上下文窗口。

★ 在训练过程中, 内容为 0

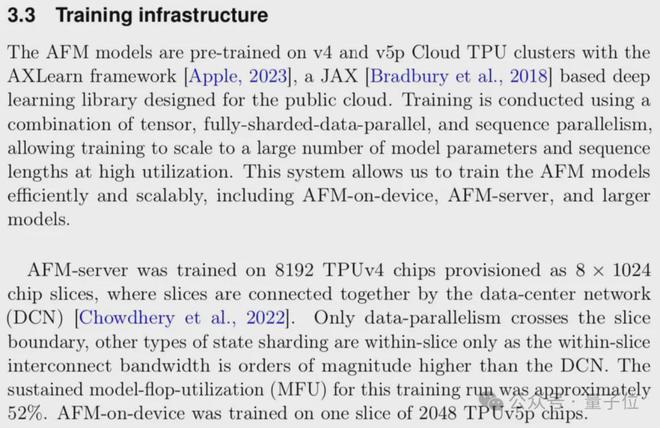

该模型使用其自身的基于JAX的框架进行训练,采用了张量并行和管道并行等策略。

使用的硬件是 TPU,云端有8192个TPUv4芯片,端有2048个芯片。简而言之,含量为0。

数据主要来自抓取的网页,以及公开许可的代码和数学数据集。

值得一提的是,苹果所选的数据集均未使用GPL,而是采用MIT、CC0等开源协议。

从流程上看,AFM预训练过程分为核心训练、持续训练和上下文扩展三个阶段。

在核心训练阶段,云端版本数据量为6.3T,窗口长度为4096,端侧版本在此基础上进行提炼。

随着训练的继续,低质量数据的权重会被降低,并且模型的功能会通过数学、代码和许可的高质量数据得到改进。

此过程使用了1T数据,窗口长度从4096变为8192。

下一阶段,窗口长度进一步扩大到32k,涉及长序列文本和合成数据,总计100B。

★独创新型强化学习算法

AFM 的后期训练包括监督微调(SFT)、带人工反馈的强化学习(RLHF)等任务。

SFT 阶段使用了合成数据和人工注释数据。合成数据主要关注数学、工具使用和代码。

在RLHF阶段,苹果创建了两种强化学习算法:iTeC和MDLOO。

iTeC 是“迭代教学委员会”的缩写,是一种用于训练后强化学习的算法,旨在通过多轮迭代来优化模型的性能。

其核心思想是结合不同的偏好优化算法,包括拒绝抽样和直接偏好优化(DPO),使得模型能够受益于多种优化策略,从而提高其针对特定任务的适应性和性能。

在每次迭代中,iTeC 都会从最新的模型中挑选出一组表现最好的模型,组成一个“模型委员会”,这些模型是通过 SFT、RS、DPO/IPO 和 RL 等不同的训练方法得到的。

通过收集人类对模型响应的偏好反馈,iTeC 不断更新其奖励模型并使用它来训练新的模型集成。

在收集了一批人类偏好数据后,iTeC 会刷新其奖励模型并训练一组新的模型,重复此循环多轮,以逐步提高模型性能。

MDLOO 是一种专门为优化模型响应质量而设计的在线强化学习算法。

作为一种在线算法,它在模型训练期间实时解码响应并应用 RL 算法来最大化奖励。

也就是说,这种方法使得模型能够在训练过程中不断学习和调整其策略,以产生更符合人类偏好的反应。

在具体实现上,它结合了留一法(LOO)优势估计器与镜像下降策略优化(MDPO),以实现更加稳定有效的策略更新。

★设备端混合精度量化

为了让端侧模型运行更高效,避免占用过多的内存资源,苹果对端侧版本的AFM进行了量化。

具体来说,苹果采用了混合精度量化的方式,针对不同的环节使用不同的量化精度。

苹果采用的方法称为“调色板”策略。在调色板量化中,权重不是单独量化的,而是分组量化,组内的权重共享相同的量化常数。

对于投影权重,每16列/行共享相同的量化常数,并使用K均值算法量化为4位。

对于 层,由于输入和输出是共享的,因此使用 8 位整数进行每通道量化。此外,一些相对不太重要的层进一步压缩为 2 位量化。

为了恢复量化后损失的性能,以保持模型的输出质量和准确率,苹果还推出了准确率恢复适配器(-)。

适配器是一个小型神经网络模块最新研究澳门王中王100%的资料2024,可以插入预训练模型的特定层,在量化模型之上进行训练,并进行微调以学习如何补偿量化的影响。

★部分任务超越 GPT-4

应用一系列优化技术后,就该验证模型性能了。

在这个过程中,苹果采取了人工评估与自动化评估相结合的策略。

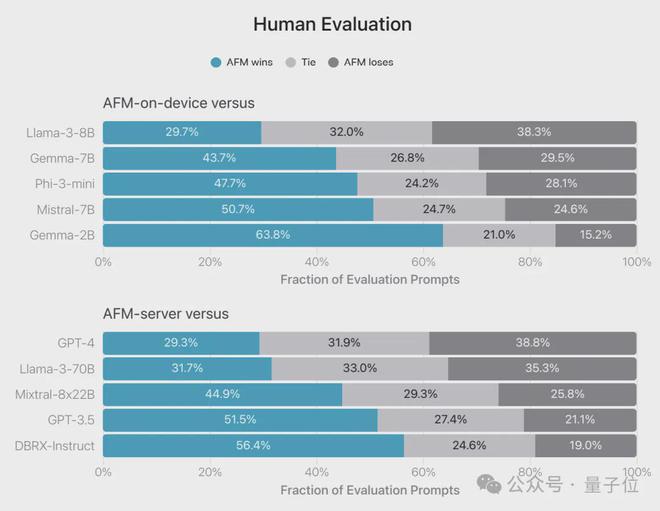

先说人工评测,评测人员设计了多种类型的问题,涵盖分析推理、头脑风暴、聊天机器人等,并让模型生成答案。

同时,问题也会被问到其他模型上,进行比较解析特马资料最准,然后评估者判断哪个模型的输出更好。

因此,无论是云端模型还是端端模型,都有至少 60% 的概率与 Llama 3、GPT-4 等对比模型相媲美。

其余测试主要利用数据集来实现。

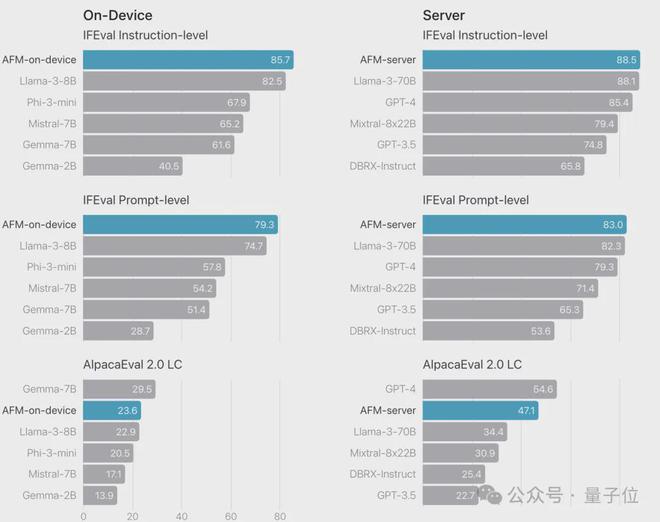

苹果对遵循指令的能力进行了测试,结果显示Cloud-side AFM在两个指令和两个层面上都超越了GPT-4,成为新的SOTA。

端侧模型的性能也超过了Llama 3-8B、-7B等同等尺寸的模型。

其中,端侧AFM和云端AFM均获得了第二名。

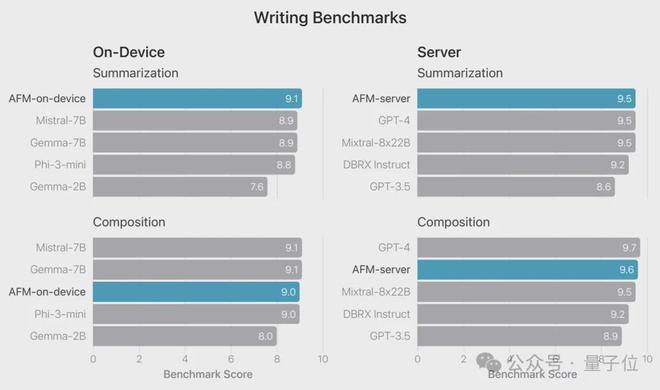

从具体任务上的表现来看,AFM 在写作类别的总结任务中取得了 SOTA,在写作任务中也接近第一名。

在数学方面,苹果使用了 GSM8K 和 MATH 两个数据集进行评估。

结果,客户端模型在GSM8K上不如Llama 3-8B和微软的Phi 3 mini,在云端则被GPT-4和Llama 3-70B超越,但优于GPT-3.5。

在MATH上的得分相对较高,客户端领先同规模机型,云端也超越了Llama 3-70B。

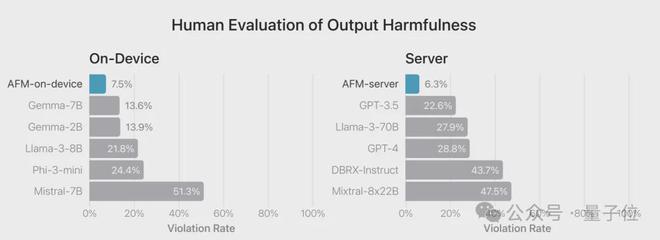

除了性能之外,安全性也很重要,苹果手动评估了AFM抵抗对抗性攻击的能力。

结果表明,面对对抗性提示时,AFM 的违规率明显低于其他开源和商业模型。

发表评论